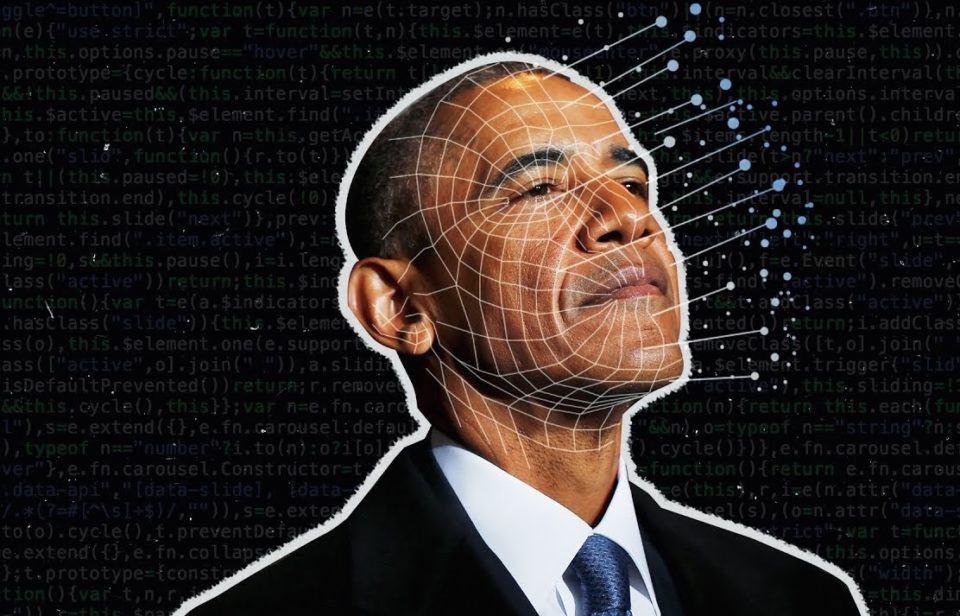

Deep Fake: La falsa identità digitale

Condividi15“Una verità poco emozionante può essere eclissata da una menzogna elettrizzante.”

– Aldous Huxley-

S

e anche voi pensate che questo sia davvero Matteo Renzi, bhe . . . la risposta è tecnicamente, non lo è, ma, quesi gesti sono stati fatti grazie all’utilizzo del Deep Faking: un attore dietro le quinte ha assunto le sembianze del politico italiano per farlo parlare e muovere come mai ha realmnte fatto.

Recentemente, il programma su Canale 5, Striscia la Notizia ne ha realizzato un vero e proprio format: Potete trovare tutti i video QUI.

In cosa consiste? “Semplicemente” nel falsificare quella che è l’identità di una persona, facendole dire e fare cose che, in realtà non avrebbe mai detto. Come nel video di cui sopra, nel quale Matteo Renzi è stato generato con degli strumenti di Deep Faking che utilizzano l’Intelligenza Artificiale.

Scopriamo insieme alcuni aspetti importanti di questo fenomeno che potrebbe cambiare il mondo intero e generare davvero importanti problemi, specialmente se utilizzato dalle mani sbagliate.

Il Deep Fake nasce principalmente, pensate un pò, nel porno. Avete letto bene, nel 2017 venne pubblicato un video hot sulla piattaforma Reddit, dove venivano ritratte alcune attrici in atti sessuali.

Ovviamente, nel giro di poche ore, il mistero venne risolto: nessuna delle attrici coinvolte era mai stata registrate in quei contesti nè tantomeno conoscevano la persona che appariva nel video.

Così il Deep Fake naque, evolvendosi e perfezionandosi durante questi anni.

Giusto per darvi un ulteriore esempio, nell’immagine in basso il viso di Arnold Schwarzenegger è stato sostituito a quello del comico-attore americano Bill Hader: Il risultato è perfetto, guardate con i vostri occhi !

Anche qui, l’Intelligenza Artificiale entra in gioco, richiedendo due diversi algoritmi.

L’encoder è quello che permette di trovare le similarità tra i due visi e li riduce ad un “viso comune”.

Dopodichè, questo “viso comune” assume le sembianze del viso prescelto con le movenze del secondo viso grazie al secondo algoritmo (decoder).

E’ interessante notare che, mentre prima, tutto questo poteva essere realizzato da esperti di informatica, con il passare degli anni, sempre più persone hanno sviluppato applicazioni e programmi che vengono venduti e disponibili al mercato di massa.

Aldilà dell’ilarità di tutto ciò, ed avendo anche l’opportunità, molto spesso, di poter “copiare” anche la voce del personaggio in questione, la questione diventa seria: se dovessero esserci dei video di politici o personaggi di spicco che dicono cose assurde, oppure che prendono decisioni che non avrebbero mai preso . . . cosa accadrebbe alla nostra società?

Immaginate una tecnologia del genere in mano a persone sbagliate che possono produrre video dannosi per il mondo intero e scatenare guerre e rivolte.

Una riflessione deve essere fatta: l’uso dell’intelligenza artificiale e delle ultime tecnologie deve essere necessariamente rivista in un modo più etico, salvaguardando la nostra società piuttosto che danneggiandola, togliendo posti di lavoro ed offrendo strumenti di danneggiamento sociale.

Per esempio, uno studio di Deeptrace ha rivelato che ci sarebbero stati all’incirca 15000 video di deepfake online solo nel Settembre 2019.

Bisogna , più che mai, essere capaci di scindere il vero dal falso ma, ancor più importante, un’informazione falsa da una veritiera: Pensate ad un video che potrebbe circolare in rete i cui un politico viene “beccato” a dire e fare qualcosa di estremamente contradditorio o addirittura minaccioso contro altre nazioni . . . Potete solo immaginare il risultato. . .

1 comment

Troppe volte mi è successo che mentre parlavo di un qualche oggetto commerciale con al fianco lo smartphone, puntualmente dopo poco tempo mi appariva esattamente la pubblicità dell’oggetto di cui stavo parlando. Questo mi è successo innumerevoli volte e non può essere un caso. Ci ascoltano e ci spiano.